リコーが開発した新しい日本語LLMとは?

リコーは、Googleが提供するオープンな大規模言語モデル(LLM)「Gemma 3 27B」をベースに、企業が自社の環境(オンプレミス)で使える、高性能な日本語LLMを開発しました。この新しいLLMは、セキュリティを重視する企業にとって最適な選択肢となります。

大規模言語モデル(LLM)ってなに?

LLMとは、人間が使う言葉(自然言語)を理解し、まるで人間が書いたかのような文章を作り出したり、質問に答えたりできるAIのことです。最近話題のChatGPTなどもLLMの一種です。今回のリコーのLLMは、特に企業が自分たちの社内ネットワークで安全に使えるように作られています。

新LLMのすごいポイント

最先端モデルに匹敵する高性能

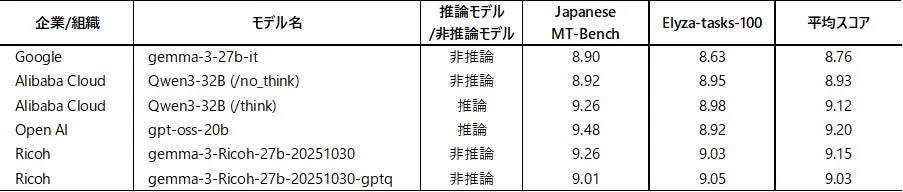

リコーが開発したLLMは、独自の「モデルマージ」という技術を使って、元のモデルから大きく性能を向上させています。約1万5千件もの「指示(インストラクション)に従って学習するデータ」を追加で覚えさせることで、米OpenAIの「gpt-oss-20b」のような最先端の高性能モデルと同じくらいのレベルの日本語能力があることが確認されました。

モデルマージ技術ってなに?

モデルマージとは、すでに学習済みの複数のLLMの良いところを組み合わせて、より賢いモデルを作る新しい技術です。たくさんの計算資源(GPUなど)がなくても、手軽に高性能なモデルを開発できると注目されています。

ユーザー体験を重視した速い応答速度と高い執筆能力

このLLMは、質問をしてから最初の言葉が返ってくるまでの時間(初期応答性)が速い「非推論モデル」というタイプです。そのため、使う人がストレスなくAIとやり取りできます。また、文章を作る能力も非常に高いため、ビジネスでの様々な用途に役立ちます。

コンパクトで環境にも優しい

このLLMは270億というコンパクトなパラメータ数でありながら、高い性能を持っています。そのため、一般的なPCサーバーなどでも動かすことができ、低コストで企業独自のAI(プライベートLLM)を導入できます。LLMはたくさんの電気を使うことが課題ですが、コンパクトなこのモデルは省エネルギーにも貢献し、環境への負荷も抑えられます。

性能評価の結果

リコーのLLMは、複雑な指示や対話能力を測る日本語の代表的なベンチマークテスト「ELYZA-tasks-100」と「Japanese MT-Bench」で評価されました。その結果、米OpenAIの「gpt-oss-20b」と同等レベルの高いスコアを示しています。

-

Japanese MT-Bench: 会話のやり取り(マルチターン対話)の能力を評価するテストです。

-

Elyza-tasks-100: 複雑な指示を理解し、実行する能力を評価するテストです。

エフサステクノロジーズとの連携で提供

この新しいLLMは、お客様の要望に応じて個別に提供されます。さらに、2025年12月下旬からは、エフサステクノロジーズ株式会社が提供するオンプレミス環境向けの対話型生成AI基盤「Private AI Platform on PRIMERGY(Very Small モデル)」に、このLLMの軽量化モデルと、生成AI開発プラットフォーム「Dify(ディフィ)」が事前にインストールされた形で提供されます。

Difyと伴走支援でAI活用をサポート

Difyを使うと、お客様はプログラミングの知識がなくても、自社の仕事に合わせた生成AIアプリケーションを簡単に作ることができます。さらに、リコージャパン株式会社が「Dify支援サービス」として、AIの専門家がいない企業でも安心してAIを活用できるよう、導入から運用までをサポートします。

関係者からのコメント

エフサステクノロジーズ株式会社 代表取締役社長 CEOの保田 益男氏は、リコーの高性能LLMと自社のAI基盤を組み合わせることで、より多くのお客様にオンプレミスAIソリューションを提供できることを喜んでいます。

株式会社リコー リコーデジタルサービスBU AIサービス事業本部 本部長の梅津 良昭氏も、Googleの「Gemma 3 27B」をベースに、オンプレミスに最適な日本語LLMを開発できたこと、そしてエフサステクノロジーズとの連携により製品化が実現したことを強調しています。

リコーのAI開発の歴史と今後の展望

リコーは1980年代からAI開発に取り組み、画像認識や自然言語処理の技術を培ってきました。2022年からはLLMの研究開発に力を入れ、独自のモデルマージ技術などを活用して、お客様に最適なプライベートLLMを提供しています。

今後は、さらに複雑な思考プロセスを持つ「推論性能」の向上や、特定の業種に特化したモデルの開発を進める予定です。また、リコーが得意とする画像や音声など様々な情報を組み合わせて理解する「マルチモーダル性能」も強化し、LLMのラインアップをさらに充実させていくとのことです。

リコーは、お客様に寄り添いながら、それぞれの仕事に合わせたAIサービスを提供することで、企業のデジタルトランスフォーメーション(DX)を支援していく方針です。

関連リンク

-

Google Gemma 3 27Bについて: https://ai.google.dev/gemma/docs/core?hl=ja

-

OpenAI gpt-oss-20bについて: https://openai.com/ja-JP/index/introducing-gpt-oss/

-

リコーのAI開発に関する情報: https://promo.digital.ricoh.com/ai/