生成AIの「ハルシネーション」とは?企業が直面する課題

近年、ChatGPTに代表される生成AIがビジネスの現場で広く使われるようになりました。しかし、AIがまるで事実かのように、誤った情報を生成してしまう現象「ハルシネーション(幻覚)」が問題視されています。

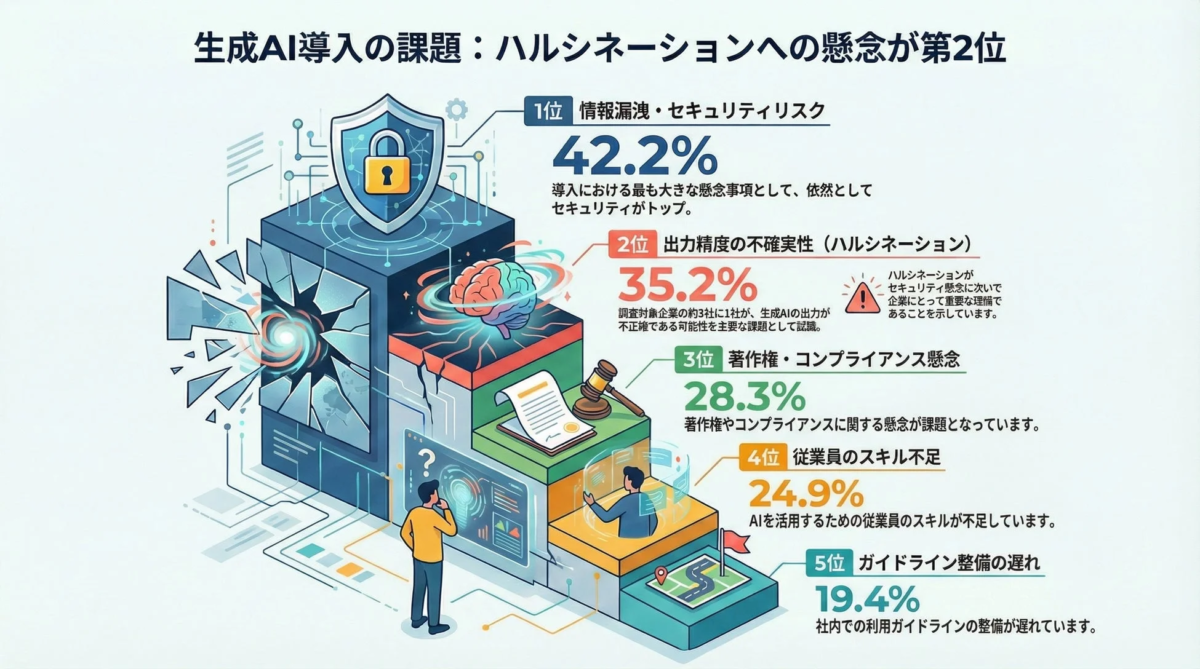

ラーゲイト株式会社が2025年12月に実施した調査によると、情報システム部門やDX推進室に所属するビジネスパーソン505名のうち、35.2%がこのハルシネーションを「課題」として認識していることが明らかになりました。これは、情報漏洩やセキュリティリスク(42.2%)に次ぐ、2番目に大きな懸念事項です。約3社に1社が、AIの出力する情報の不確かさが業務の妨げになると感じています。

なぜハルシネーションは起こるのか?

生成AIは「もっともらしい文章を作る」ことを得意としていますが、必ずしも「正確な情報を出力する」ように作られているわけではありません。学習データの限界、文脈の誤解、最新情報への非対応などが原因で、AIが自信たっぷりに間違った情報を提示することがあります。

特に、ビジネスの意思決定に使われる「情報収集・調査・分析」の分野や、品質が重要な「システム開発・運用」の分野でAIが誤った情報を出力すると、企業に直接的な損失をもたらす可能性があります。ラーゲイトは、このようなハルシネーションの実態を明らかにし、企業が取り組むべき対策を示すために今回の調査を実施しました。

調査結果のポイント

1. ハルシネーションがセキュリティに次ぐ重要課題に

生成AIを導入する際の課題について尋ねたところ、以下の結果が得られました。

-

情報漏洩・セキュリティリスク:42.2%(1位)

-

出力精度の不確実性(ハルシネーション):35.2%(2位)

-

著作権・コンプライアンス懸念:28.3%(3位)

-

従業員のスキル不足:24.9%(4位)

-

ガイドライン整備の遅れ:19.4%(5位)

この結果から、ハルシネーションは単なる「使い方」の問題ではなく、企業全体で取り組むべき経営課題として認識されていることが分かります。

2. 「情報収集・分析」が最もリスクの高い分野

業務の分野別にAIの活用状況とハルシネーションのリスクを分析したところ、「情報収集・調査・分析」の分野(活用率39.2%)が最もリスクと影響度が高いとされました。誤った市場データや競合情報に基づいて判断を下すと、ビジネスに直接的な損害が出る可能性があるためです。

また、「システム開発・運用」(活用率37.4%)では、AIが生成したコードに問題が混入するリスクがあり、人間のチェックが欠かせません。「議事録作成・要約」(活用率28.1%)は比較的リスクが低いものの、情報の偏りには注意が必要です。

3. 最も効果的な対策は「RAG」の導入

ハルシネーションを減らすための最も根本的で効果的な方法は、「RAG(Retrieval-Augmented Generation:検索拡張生成)」の導入です。これは、AIが回答を生成する際に、社内のデータベースや信頼できる情報源を参考にさせることで、より事実に基づいた正確な回答を引き出す技術です。

RAG以外にも、以下のような対策が有効です。

-

ファクトチェック体制の構築:AIの出力内容を自動で検証し、人間が確認・修正するプロセスを設ける。

-

プロンプトエンジニアリングの最適化:AIへの指示(プロンプト)に「分からない場合は『分かりません』と答える」「不確かな部分には【要確認】と書く」といった条件を明確に加える。

-

用途に応じたモデルの選定:事実確認を重視する、コストを抑える、日本語に特化するなど、目的に合わせて最適なAIモデルを選ぶ。

-

継続的なモニタリングと改善:ハルシネーションの発生率などを常に監視し、改善を続ける仕組みを作る。

ハルシネーションはコントロール可能

今回の調査結果が示す重要なメッセージは、ハルシネーションを完全にゼロにすることは難しいものの、許容できる範囲に抑えることは可能だという点です。生成AIを業務に本格的に取り入れる企業が増えるにつれて、出力品質の管理は「ITの問題」から「経営の問題」へと変化していくでしょう。

ラーゲイトは、RAGとノーコードツール(Difyなど)を組み合わせることで、これまで専門的な知識が必要だったRAG環境の構築が、より手軽にできるようになると注目しています。さらに、Amazon Bedrockと連携してAWS上で安全に利用することで、企業の2大課題であるセキュリティとハルシネーションの両方を解決できる道筋が見えてきています。

今後、企業のAI活用は「使うかどうか」ではなく、「品質をどのように確保しながら使うか」という段階へ移行していくと予測されます。ハルシネーション対策を自社でできる企業とそうでない企業の間には、業務の質や意思決定の精度において大きな差が生まれるでしょう。

ラーゲイトでは、AWS FTR認定を取得した専門チームが、Difyを使ったRAG環境の構築からAWSでの安全な運用、社内人材の育成までを一貫してサポートしています。RAG導入や信頼性の高いAIチャットボットの構築に関する相談を受け付けています。

より詳しい調査レポートはこちらから確認できます。

https://www.ragate.co.jp/media/developer_blog/5sqg5zb20

ラーゲイト株式会社の提供するサービス例: