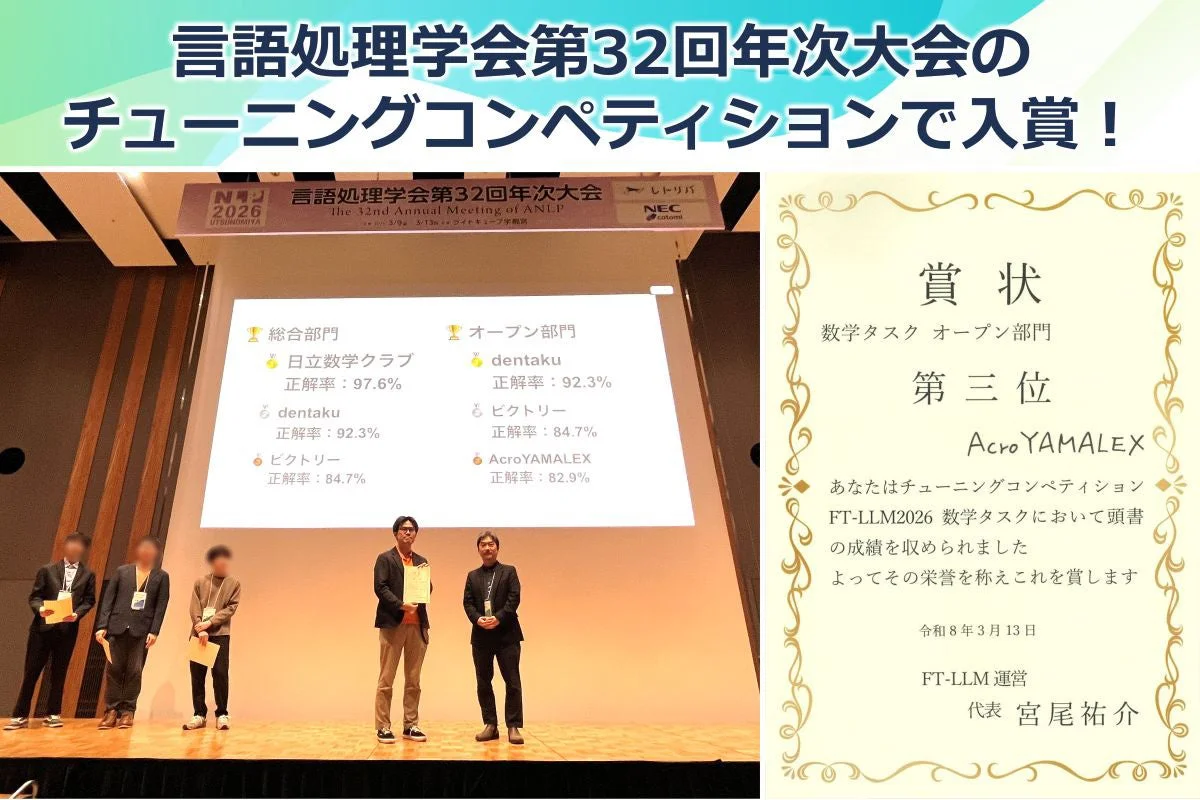

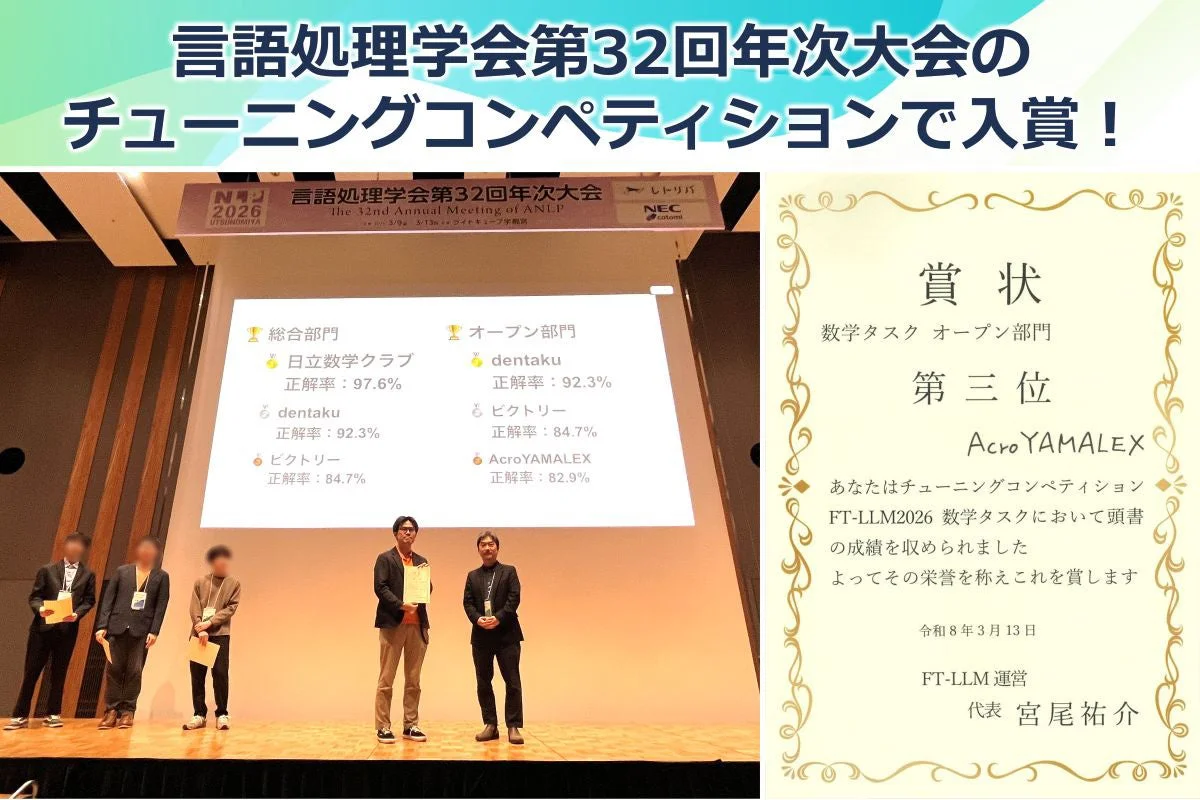

AcroYAMALEXチームが言語処理学会NLP2026チューニングコンペティション数学タスク部門で第3位に輝く

アクロクエストテクノロジー株式会社のデータサイエンスチーム「AcroYAMALEX」(以下、YAMALEX)が、言語処理学会第32回年次大会(NLP2026)で開催されたチューニングコンペティションの数学タスク部門で第3位を受賞しました。

大規模言語モデルのファインチューニング技術を競うワークショップ

このコンペティションは、「大規模言語モデルのファインチューニング技術と評価」ワークショップの一環として実施されました。大規模言語モデル(LLM)とは、たくさんの言葉を学習して、人間のように文章を作ったり質問に答えたりできるコンピュータープログラムのことです。ファインチューニングとは、このLLMに特定のテーマ(今回の場合は数学)をさらに詳しく教え込むことで、そのテーマに関する精度を高める技術を指します。

コンペティションの数学タスクでは、日本の中学校や高等学校で扱われる数学の問題を対象に、LLMを基盤としたシステムを構築し、その回答精度が競われました。YAMALEXチームは、オープン枠で参加し、最終的なシステムをOSS(オープンソースソフトウェア)ライセンスで公開することが条件とされていました。

YAMALEXチームの成果と技術

全24チームが参加する中、YAMALEXチームは数学タスク部門で堂々の第3位を獲得しました。

YAMALEXチームは、オープンライセンスのデータセットとモデルのみを使用し、数学問題に回答するモデルを構築しました。特に、LLMを活用して「合成データ」と呼ばれる新しいデータを作成することで、高い精度のモデルを実現しました。

参加チーム概要

-

チーム名: AcroYAMALEX(アクロヤマレックス)

-

メンバー: 佐々木 峻、山本 大輝、樋口 慎、吉岡 駿

機械学習エンジニアの佐々木氏からは、「今回のオープン枠は、オープンライセンスのモデル・データのみが使用可能というルールがあり、利用可能なデータセットが限られる中で、モデル構築に多くの工夫が必要でした。ライセンスの制約も含め、モデル開発の難しさを実感できる貴重な経験となりました」とのコメントが寄せられています。

アクロクエストテクノロジーは、これからもAIや機械学習、データ分析・解析の技術向上に努め、顧客の課題解決とより良いサービスの創出を目指していく方針です。

参考情報

-

言語処理学会第32回年次大会(NLP2026)第2回「大規模言語モデルのファインチューニング技術と評価」ワークショップ チューニングコンペティション

https://llm-jp.github.io/tuning-competition/2026/workshop.html -

言語処理学会第32回年次大会(NLP2026)

https://anlp.jp/nlp2026/ -

AcroYAMALEXについて

https://www.acroquest.co.jp/business/acro-yamalex/